Již dříve jsem zmiňoval budoucnost předpokládaného vývoje v oblasti průmyslových robotů směrem k integraci hlasového ovládání, tedy přesněji řečeno možnosti přímo interagovat s budoucím AI průmyslovým robotem (AI kobotem) prostřednictvím hlasu podobně jako se svým lidským kolegou - viz článek Budoucnost kolaborativních robotů - hlasové ovládání a gesta. S rychlým vylepšováním nových jazykových modelů systémů generativní umělé inteligence a podporou nových technologií NVIDIA se tato doba již stává skutečností.

NVIDIA a robotika

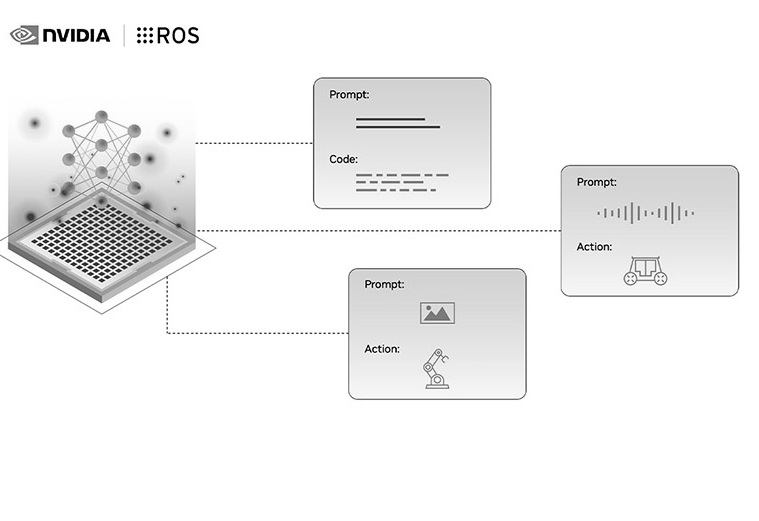

Edge AI a robotika začínají být lákavými trhy i pro NVIDIA and Co. Generativní AI by totiž robotům umožňovala vnímat a chápat kontext svého prostředí, přirozeně komunikovat s lidmi a činit adaptivní rozhodnutí nezávisle. K tomu slouží projekt ReMEmbR. Ten kombinuje LLM, VLM a retrieval-augmented generation (RAG), aby umožnil robotům uvažovat nad tím co vidí a provádět akce v časovém horizontu hodin až dnů. Navíc je založena a implementována na robotický řídicí a programovací systém ROS 2. Využívá se zde tedy generativní AI ke zlepšení logického myšlení a jednání i běžných průmyslových kolaborativních a mobilních robotů. Tím, že kombinuje velké jazykové modely (LLM), vizuální jazykové modely (VLM) a generování založené na vyhledávání, umožňuje robotům vytvářet a získávat dlouhodobé sémantické paměti a zlepšit jejich schopnost navigace a interakce s prostředím.

Edge AI a robotika začínají být lákavými trhy i pro NVIDIA and Co. Generativní AI by totiž robotům umožňovala vnímat a chápat kontext svého prostředí, přirozeně komunikovat s lidmi a činit adaptivní rozhodnutí nezávisle. K tomu slouží projekt ReMEmbR. Ten kombinuje LLM, VLM a retrieval-augmented generation (RAG), aby umožnil robotům uvažovat nad tím co vidí a provádět akce v časovém horizontu hodin až dnů. Navíc je založena a implementována na robotický řídicí a programovací systém ROS 2. Využívá se zde tedy generativní AI ke zlepšení logického myšlení a jednání i běžných průmyslových kolaborativních a mobilních robotů. Tím, že kombinuje velké jazykové modely (LLM), vizuální jazykové modely (VLM) a generování založené na vyhledávání, umožňuje robotům vytvářet a získávat dlouhodobé sémantické paměti a zlepšit jejich schopnost navigace a interakce s prostředím.

Roboti se systémem ROS 2 s přidaným hlasovým ovládáním využívají službu NVIDIA Riva ASR-TTS, která jim umožňuje rozumět i mluveným příkazům a reagovat na ně. Nicméně NVIDIA není v tomto samotná. V návaznosti na to například laboratoř NASA Jet Propulsion Laboratory letos předvedla technologii ROSA, což je AI-poháněný agent pro systém ROS běžící na robotu Nebula SPOT a robotu NVIDIA Nova Carter. Společnost Canonical pak předvedla NanoOWL, což je model rozpoznávání objektů běžící na NVIDIA Jetson Orin Nano System-on-Module. Ten umožňuje robotům identifikovat různé objekty v reálném čase bez potřeby vytvářet statické snímky, a aniž by se musely spoléhat na předem definované kategorie. A nakonec i známá robotické společnost Universal Robots využívající technologii ROS také spoléhá na produkty NVIDIA. Navíc představila svůj UR AI Accelerator, což je hardwarová a softwarová sada nástrojů pro pokrok ve vývoji aplikací kobotů s podporou AI. Je tedy patrné, že v této oblasti nastává významný progres.

Roboti se systémem ROS 2 s přidaným hlasovým ovládáním využívají službu NVIDIA Riva ASR-TTS, která jim umožňuje rozumět i mluveným příkazům a reagovat na ně. Nicméně NVIDIA není v tomto samotná. V návaznosti na to například laboratoř NASA Jet Propulsion Laboratory letos předvedla technologii ROSA, což je AI-poháněný agent pro systém ROS běžící na robotu Nebula SPOT a robotu NVIDIA Nova Carter. Společnost Canonical pak předvedla NanoOWL, což je model rozpoznávání objektů běžící na NVIDIA Jetson Orin Nano System-on-Module. Ten umožňuje robotům identifikovat různé objekty v reálném čase bez potřeby vytvářet statické snímky, a aniž by se musely spoléhat na předem definované kategorie. A nakonec i známá robotické společnost Universal Robots využívající technologii ROS také spoléhá na produkty NVIDIA. Navíc představila svůj UR AI Accelerator, což je hardwarová a softwarová sada nástrojů pro pokrok ve vývoji aplikací kobotů s podporou AI. Je tedy patrné, že v této oblasti nastává významný progres.

Hlasové ovládání robota a další AI funkce

Sady nástrojů "Jetbot Voice-Activated Copilot Tools" umožňují každého robota programovaného pomocí technologie ROS2 vybavit funkcí hlasově aktivovaného druhého pilota. Tato sada / projekt využívá schopnosti služby Nvidia Riva ASR-TTS, což umožňuje robotovi rozumět mluveným příkazům a reagovat na ně.

Sady nástrojů "Jetbot Voice-Activated Copilot Tools" umožňují každého robota programovaného pomocí technologie ROS2 vybavit funkcí hlasově aktivovaného druhého pilota. Tato sada / projekt využívá schopnosti služby Nvidia Riva ASR-TTS, což umožňuje robotovi rozumět mluveným příkazům a reagovat na ně.

"Jetbot Voice-Activated Copilot Tools" je výsledkem nejnovější letošní aktualizaci (označované jako V2) předchozí sady nástrojů "Jetbot Voice To Action Tools" (označované jako verze V1). K vlastnostem a možnostem verze V1, jako jsou přirozené chatovací pozdravy, samořízení pomocí Lidaru pro vyhýbání se objektům a sledování osob v reálném čase, tak přibyly další funkce pro zlepšení interakce robota. Verze V2 totiž zavádí podporu pro více modelů umělé inteligence, včetně podpory chatu LLM a VLM.

Mezi hlavní vlastnosti sady nástrojů "Jetbot Voice-Activated Copilot Tools" tedy patří:

- Procesor Jetbot ASR - umožňuje robotovi dekódovat lidské hlasové zprávy pomocí klientského uzlu ROS2 Nvidia Riva ASR.

- Procesor Jetbot TTS - převádí text z odpovědí chatu generované AI modely LLM a VLM na řeč pomocí služeb Nvidia Riva TTS. Vygenerovaný řečový soubor je poté přehráván přes reproduktor robota. Tato funkce zlepšuje interakci mezi robotem a lidmi, takže je poutavější a uživatelsky přívětivější.

- Jetbot ASR Agent - umožňuje vytvořit jednoduchý model 1D konvoluční neuronové sítě (CNN) pro předvídání záměrů lidského hlasu a následného vhodného sloučení posloupnosti výsledků LLM chatu a VLM vidění na akce, které by měl robot provést.

- Jetbot Voice Tools Copilot (sada nástrojů první verze V1) - provádí akce odpovídající hlasovým příkazům zaslaným prostřednictvím tématu ROS2 od Jetbot ASR Agent. Mezi podporované akce patří:

- Large Language Model (LLM) Chat - realizuje chat s pomocí velkého jazykového modelu (LLM), tedy umožňuje Jetbotu reagovat pomocí chatu LLM.

- Vision-Language Model (VLM) Robot Camera Image Description - umožňuje popis obrázku z robotické kamery pomocí modelu Vision-Language Model (VLM). Umožní tak Jetbotu popisovat snímky zachycené jeho kamerou.

- Samořízení s podporou Lidaru - podporuje bezpečnou navigaci a vyhýbání se objektům.

- Detekce objektů v reálném čase – podporuje bezproblémové sledování osob.

- Základní navigační příkazy robota – umožňují základní hlasové ovládání, jako je pohyb vpřed/vzad a zatáčení doleva/doprava.

Blokové schéma systému Jetbot (větší lépe čitelný obrázek - zde )

Závěr

Pokud si vývoj generativních systémů AI udrží tempo jako v posledních letech nebo ještě bude dále zrychlovat, tak si troufám říct, že hlasové ovládání průmyslových kolaborativních robotů, alespoň co se anglického jazyka týče, bude za několik let již zcela běžnou funkcí. Je totiž již patrné, že velké společnosti na AI systémy již nespoléhají jen na různé kancelářské, poradenské, plánovací a vyhledávací aplikace, ale jsou z investičních důvodů již nuceny se vážně a masivně začít zapojovat i do průmyslové automatizace výroby a logistiky. Oblast robotů se v tomto ohledu samozřejmě na první pohled nabízí jako nejvíce vhodná. Nicméně průmyslové systémy potřebují vykazovat výrazně větší spolehlivost a předvídatelnost své funkce než například zmíněné kancelářské, radící a vyhledávací aplikace. Testování a odladění AI funkcí v průmyslových aplikacích je tedy vždy obtížnější a časově náročnější i s ohledem na často horší dostupnost vhodných trénovacích dat.

Odkazy:

- Článek "NVIDIA relies on ROS" - https://www.hannovermesse.de/en/news/news-articles/nvidia-relies-on-ros

- Článek "NVIDIA offers ROS developers generative AI tools plus simulation, perception workflows" - https://www.therobotreport.com/nvidia-offers-ros-developers-gen-ai-tools-simulation-perception-workflows/

- Článek "Jetbot Voice-Activated Copilot Tools with Nvidia RIVA and NanoLLM Container for ROS2 Robot - version 2.0" - https://forums.developer.nvidia.com/t/jetbot-voice-activated-copilot-tools-with-nvidia-riva-and-nanollm-container-for-ros2-robot-version-2-0/307490